Daily-211027

本文最后更新于:October 27, 2021 pm

- 2021年10月27日-星期三-晴

- 主要收获:

- 阅读论文《LSC-GAN: Latent Style Code Modeling for Continuous Image-to-image Translation》

- 一堆的课:英语、网络安全、算法分析……

关于连续域的图像生成问题——LSC-GAN

(Image-to-image问题)

1.Motivation

当前I2I工作主要在离散域上进行操作(如CycleGAN、StarGAN),而缺少对连续域的研究,不同域之间的相关性常常被忽略,生成图像的多样性不佳,而实际上,标签映射的特定属性往往不是分散的,它们往往被描述为一个连续的数值。本文旨在建立一个模型,实现图像的连续域之间的转换。

2.Related Work

- 两个域之间的转换:Pix2Pix、CycleGAN、DualGAN、DiscoGAN等;

- 多个域之间的转换:StarGAN、AttGAN、ST-GAN、SMIT、ELEGANT、HomoGAN等;

- 连续域I2I转换:LIFE、SAM、DLOW等;

3.Method

3.1 baseline

StarGANv2的基础上进行

- 生成器backbone:自编码器,每层的特征被样式向量影响。

- 针对label-based方式:

- 映射网络F:直接映射域特征到样式代码,应用多分支结构。

- 分支的输出会被label影响。

- 针对reference-based方式:

- 直接编码参考图像到样式向量中,CNN采用多分支结构。

- 应用AdaIN的方式完成样式向量到G的映射。

3.2 整体流程

(我的一些理解:)

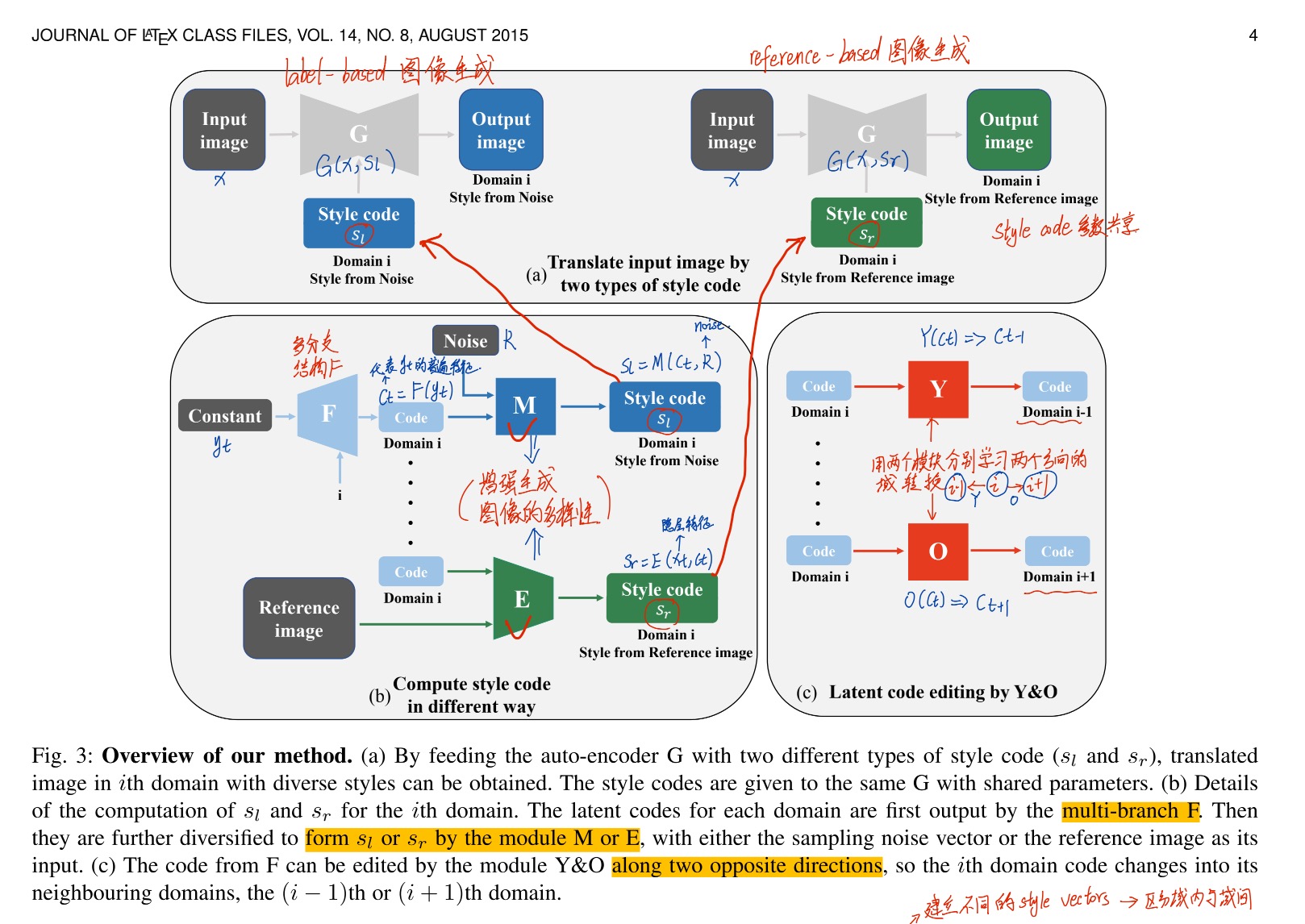

- 图a:表示两种图像生成的方式,label-based与reference-based。其中s代表样式代码(style code),与域的风格有关。生成器G则根据s与输入图像进行训练,style code会有参数共享。

- 图b:yt表示一个连续域的一部分,yi与yj不重叠,yt通过一个多分支网络结构F学习到域中心的特征,也就是ct,代表yt这个域区间内最普遍的特征,ct与R输入M中,即学习label-based图像生成对应的样式sl;ct与reference image输入E中,即学习reference-based图像生成对应样式sr。

- 图c:Y与O代表两个模块,分别学习相反过程的域的特征的转换,输入和输出均为code,也就是图b由F学到的ct。

- 生成器:就是一个Auto-encoder,用AdaIN的方式将style code输入到G中。

- 判别器:判断图像来源于哪一个域,区分图像是否真实。

总的来说,文章的创新点在于连续域的提出,并且大部分工作在于域的特征的一些提取与处理,以更好地得到图像的多样性。

3.3 损失函数

首先定义:

连续域一致性:

三元组损失:

Cycle连续一致损失:

总体优化函数:

3.4 实验结果